Jakie jest znaczenie AI Actu dla marketerów? (wykład)

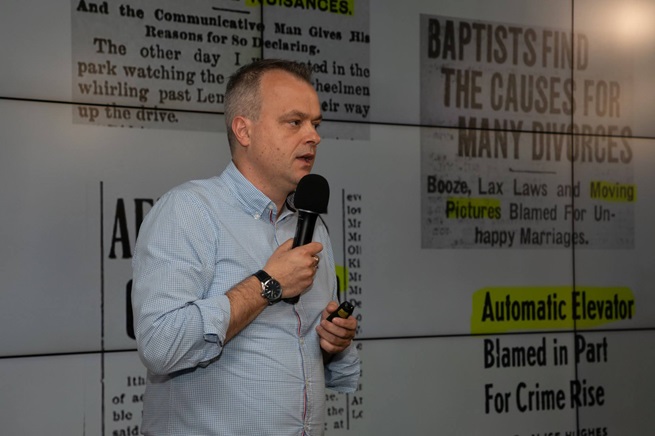

Podczas konferencji „Technologiczna rewolucja w mediach” dr Damian Flisak omawiał wpływ Aktu ws. sztucznej inteligencji (AI Act) na działania marketerów. Jest to kompleksowy akt prawny dotyczący tworzenia i funkcjonowania inteligentnych algorytmów zdefiniowanych w Akcie mianem „sztucznej inteligencji”. Ma on na celu zapewnienie twórcom i instalatorom sztucznej inteligencji jasnych wymogów i obowiązków dotyczących konkretnych zastosowań sztucznej inteligencji.

Mecenas Flisak tłumaczył, że AI akt to rozporządzenie, które przeszło już ścieżkę legislacyjną i czeka na opublikowanie; można założyć, że w lipcu ten akt wejdzie w życie. Większość przepisów, które się znajdują się w nim, nabiorą mocy (staną się obowiązujące) dopiero po dwóch latach, ale są takie, które będą obowiązujące już po sześciu miesiącach, czyli do końca 2024 roku, i takie, które staną się obowiązujące po trzech latach.

Mecenas w swoim wystąpieniu zaznaczył, że wejście w życie AI Aktu nie zrewolucjonizuje podejścia marketingowców do marketingu, natomiast istnieją w tym akcie pewne zapisy, których marketing bezwzględnie będzie musiał przestrzegać z uwagi na surowe kary.

Wg dr Filisaka wpływ e-aktu na marketing można podzielić na dwie płaszczyzny: meta i detaliczną. Odnośnie wpływu meta - Komisja Europejska przyjęła zasadę bezkompromisowego antropocentryzmu, jeśli chodzi o sposób uregulowania sztucznej inteligencji. Chodzi o to, że pokategoryzowano modele sztucznej inteligencji pod kątem tego, jakie ryzyka generuje.

Pierwsza kategoria dotyczy systemów sztucznej inteligencji generujących wysokie ryzyko – te systemy są nieakceptowalne i będą zakazane. Zakazane jest swego rodzaju podprogowe oddziaływanie. Każde oddziaływanie reklamy na klienta musi być uświadomione, nie wolno celowo manipulować ani wprowadzać w błąd. To jest już w wielu przepisach, a w AI Akcie jest podkreślone raz jeszcze.

Druga kategoria, to modele AI generujące dość duże ryzyko, ale jednocześnie zysk z ich zastosowania - one będą dozwolone pod istotnymi obostrzeniami. Ograniczone ryzyko odnosi się do ryzyka związanego z brakiem przejrzystości w stosowaniu sztucznej inteligencji. AI Akt wprowadza szczególne obowiązki w zakresie przejrzystości w celu zapewnienia, aby ludzie byli informowani w razie potrzeby, zwiększając zaufanie.

Trzecia i czwarta kategoria dot. pozostałych zastosowań AI o minimalnym ryzyku lub bez ryzyka, takich jak translatory internetowe, firewalle, filtry spamu, czy inne - to nie podlega większym obostrzeniom.

Transparentność komunikacji i przejrzystość jedną z podstaw AI Act

Z marketingowego punktu widzenia istotne jest to, że jedną z podstaw aktu dot. sztucznej inteligencji, jest transparentność komunikacji i przejrzystość. AI Act nakazuje wytłumaczenie sposobu działania modeli AI jak najlepiej i najprościej. - AI akt nakłada obowiązek transparentności, czyli jeżeli nawiązujecie kontakt ze swoim klientem, to on musi wiedzieć, czy kontakt jest nawiązywany przez chatbota, czy też przez chatbota o imieniu Krystyna, czy przez pana Mariana – dodaje Flisak.

Klienci powinni być świadomi, że wchodzą w interakcję z maszyną, aby mogli podjąć świadomą decyzję o kontynuowaniu transakcji lub cofnięciu się. Dostawcy będą musieli zapewnić identyfikowalność treści generowanych przez sztuczną inteligencję.

- Drugi wymiar transparentności jest taki, że jeżeli na przykład jakiś tygodnik zamieszcza bardzo krzykliwe okładki, i tym przyciąga rzesze czytelników, i ta okładka naśladuje rzeczywistość, a więc jest to np. sztucznie stworzona twarz polityka, aktora, ale również jakiegoś zwierzęcia; jeżeli udajecie rzeczywistość, która nie jest rzeczywistością, tylko syntetycznie wykreowaną rzeczywistością, czyli deepfake'iem, to musicie oznaczyć, że to jest deepfake – twierdzi mecenas Flisak.

Trzeci wymiar to implementacja cyfrowych znaczników, czyli oznaczanie, że coś jest syntetyczne albo nie. - Jest to sytuacja, kiedy posługujecie się stable diffusion, czy dalim, czy innym narzędziem graficznym i ono wam generuje syntetycznego kotka; AI nakłada obowiązek zaimplementowania w te dane informatyczne tego pliku, który upostaciowuje tego kotka, informację, że to jest syntetyczny kotek, czyli oznaczenie proweniencji treści, contentu, czy maszynowa proweniencja jest stworzona przez AI, czy przez człowieka – wyjaśnia Flisak.

Damian Flisak - radca prawny, ekspert prawa nowych technologii i własności intelektualnej.

Od ponad 20 lat zajmuje się własnością intelektualną, w szczególności prawem autorskim, a od paru lat sztuczną inteligencją. Jest również członkiem ekspertów Komisji Europejskiej w zakresie sztucznej inteligencji, współautor opinii dotyczącej szkód spowodowanych przez sztuczną inteligencję.

Newsletter

Newsletter

Radykalne kroki przeciw piractwu. Blokowane są przystawki z Android TV

Radykalne kroki przeciw piractwu. Blokowane są przystawki z Android TV  Znany kanał znika z pozycji orbitalnej Polsat Box i Canal+

Znany kanał znika z pozycji orbitalnej Polsat Box i Canal+  Auchan testuje nową sieć sklepów. Powalczy z Biedronką i Lidlem

Auchan testuje nową sieć sklepów. Powalczy z Biedronką i Lidlem  Takiego serialu w Polsce jeszcze nie było. Twórczyni „Matek pingwinów” tłumaczy pomysł

Takiego serialu w Polsce jeszcze nie było. Twórczyni „Matek pingwinów” tłumaczy pomysł  Nie będzie fuzji platform cyfrowych. Porozumienie anulowane

Nie będzie fuzji platform cyfrowych. Porozumienie anulowane

Dołącz do dyskusji: Jakie jest znaczenie AI Actu dla marketerów? (wykład)